Overview

Google TurboQuant: 혁신적인 AI 모델 압축 알고리즘과 시장의 반응 분석

Google TurboQuant: 혁신적인 AI 모델 압축 알고리즘과 시장의 반응 분석

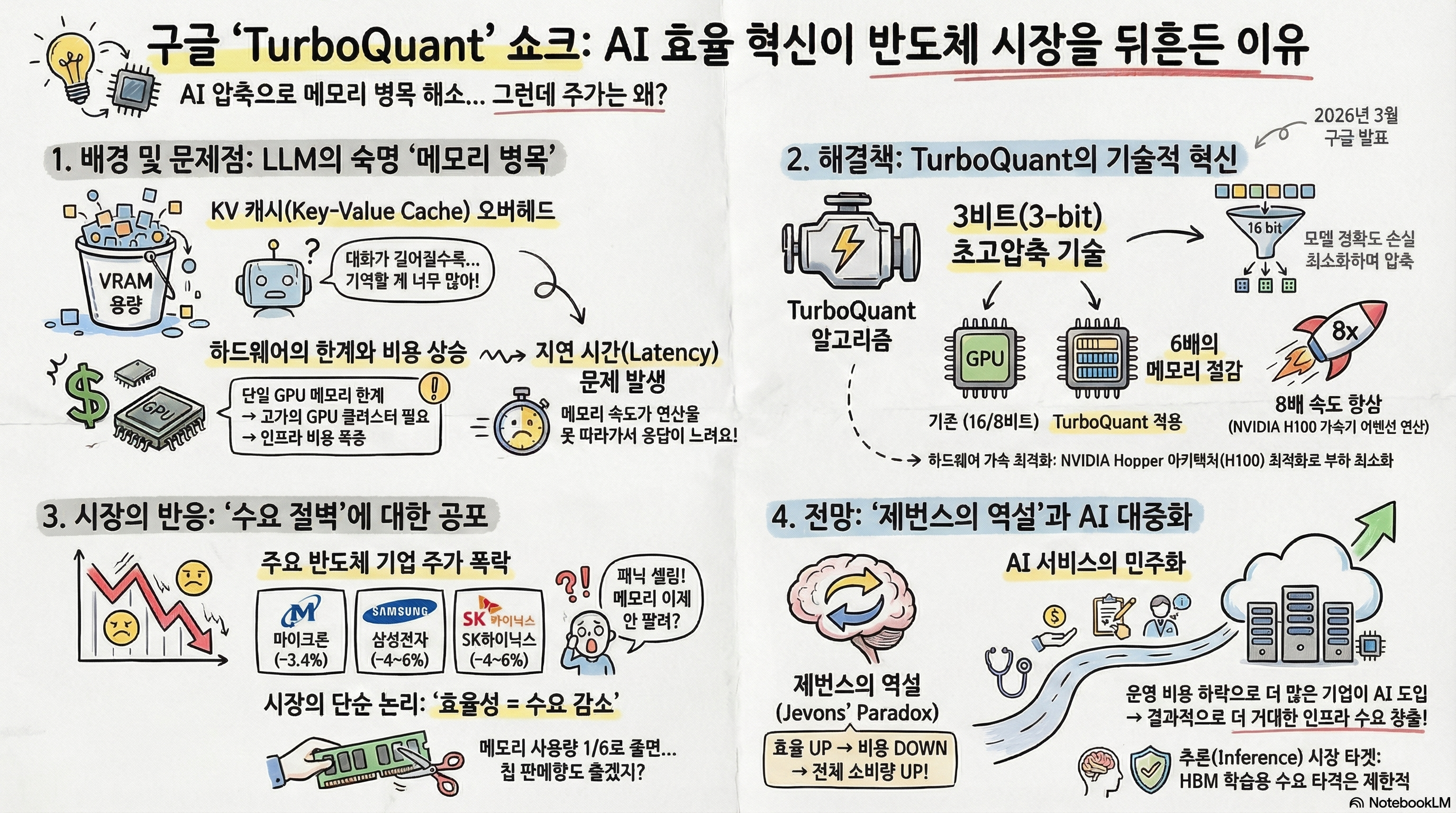

2026년 3월 25일(현지시간), 전 세계 반도체 시장은 구글 리서치(Google Research)의 발표 하나로 크게 요동쳤습니다. 구글이 ICLR 2026 컨퍼런스에서 발표할 예정인 새로운 AI 모델 압축 알고리즘, **‘TurboQuant’**가 그 주인공입니다.

이 기술은 거대언어모델(LLM) 운영의 핵심 병목 지점인 메모리 사용량을 획기적으로 줄여주지만, 역설적으로 시장은 이를 ‘메모리 수요 감소’의 신호로 받아들였습니다. 마이크론(Micron), 삼성전자, SK하이닉스 등 주요 메모리 제조사들의 주가가 일제히 하락한 배경과 TurboQuant의 구체적인 기술적 실체를 분석해 봅니다.

Background / Problem: LLM의 숙명, ‘메모리 병목’

거대언어모델(LLM)이 답변을 생성할 때, 이전 대화의 문맥을 기억하기 위해 KV(Key-Value) 캐시라는 데이터를 VRAM(비디오램)에 저장합니다. 대화가 길어질수록 이 캐시의 크기는 기하급수적으로 늘어나며, 이는 다음과 같은 문제를 야기합니다.

- 메모리 부족: 수천 건의 문맥을 유지하려면 GPU 한 대의 메모리로는 부족해 여러 대의 GPU를 엮어야 합니다.

- 비용 증가: 더 많은 메모리가 필요하다는 것은 더 비싼 인프라 비용을 의미합니다.

- 지연 시간(Latency): 메모리에서 데이터를 읽고 쓰는 속도가 연산 속도를 따라가지 못해 답변 생성이 느려집니다.

지금까지 반도체 업계는 이를 해결하기 위해 HBM(고대역폭 메모리)의 용량을 늘리는 데 집중해 왔습니다. 하지만 구글은 하드웨어가 아닌 소프트웨어(알고리즘) 측면에서 이 문제를 정면 돌파하겠다고 선언한 것입니다.

Solution / Implementation: TurboQuant의 기술적 혁신

TurboQuant는 단순히 데이터를 압축하는 것을 넘어, AI 모델의 정확도를 유지하면서도 메모리 점유율을 극단적으로 낮추는 알고리즘입니다.

1. 3비트 KV 캐시 압축 (3-bit Compression)

기본적으로 모델 파라미터나 캐시는 16비트(FP16) 또는 8비트(INT8) 수준에서 처리됩니다. TurboQuant는 이를 단 3비트로 압축하면서도 모델의 성능(Perplexity) 저하를 최소화했습니다.

2. 하드웨어 가속 최적화

단순 압축은 압축을 푸는 과정(Decompression)에서 CPU/GPU 부하를 주지만, TurboQuant는 엔비디아의 H100(Hopper) GPU 가속기에 최적화되어 설계되었습니다.

| 핵심 지표 | 개선 수치 | 비고 |

|---|---|---|

| 메모리 사용량 (Memory Footprint) | 최대 6배 절감 | 동일 GPU에서 6배 더 긴 문맥 처리 가능 |

| 연산 속도 (Attention Speed) | 최대 8배 향상 | H100 GPU 기준 어텐션 연산 가속화 |

| 압축 정밀도 | 3-bit | 정확도 손실 최소화 설계 |

3. 주요 구현 원리

TurboQuant는 데이터의 분포를 분석하여 중요한 정보는 보존하고, 덜 중요한 정보 위주로 비트 수를 줄이는 다이내믹 퀀타이제이션(Dynamic Quantization) 기술을 활용합니다. 특히 LLM의 ‘어텐션 메커니즘’에서 발생하는 캐시 오버헤드를 타겟팅하여 최적화 효율을 극대화했습니다.

Deep Dive: 시장의 반응과 ‘제번스의 역설’

왜 주가는 하락했는가?

발표 직후 미 증시에서 마이크론(MU)은 약 3.4%, 웨스턴 디지털(WDC)은 4.7% 하락했으며, 국내 삼성전자와 SK하이닉스 역시 4~6%대의 급락세를 보였습니다. 시장의 논리는 단순했습니다.

“구글의 기술로 메모리를 6분의 1만 써도 된다면, 앞으로 메모리 반도체가 덜 팔리지 않을까?”

공급자 관점에서는 수요 절벽을 우려하는 ‘패닉 셀’이 발생한 것입니다.

전문가들의 분석: “제번스의 역설(Jevons’ Paradox)”

하지만 많은 기술 업계 전문가들은 이번 하락이 과도한 반응이라고 지적합니다. 여기서 등장하는 개념이 바로 제번스의 역설입니다.

- 원리: 효율적인 기술이 등장해 자원 소모량이 줄어들면, 오히려 그 자원의 전체 수요는 폭발적으로 증가한다는 경제 이론입니다.

- 적용: TurboQuant로 AI 운영 비용이 저렴해지면, 더 많은 기업이 더 큰 규모로 AI를 도입하게 됩니다. 즉, 개별 연산당 메모리 사용량은 줄지만, 전체 서비스 규모가 커지면서 총 메모리 수요는 결과적으로 증가할 것이라는 예측입니다.

Inference(추론) vs Training(학습)

또한, TurboQuant는 주로 추론(Inference) 단계에서의 VRAM 최적화에 집중되어 있습니다. 현재 메모리 반도체 업계의 초고성능 시장인 HBM(학습용) 수요에는 즉각적인 타격이 적을 것이라는 점도 명확히 해야 합니다.

Key Takeaways

- 기술 혁신: 구글의 TurboQuant는 KV 캐시를 3비트로 압축하여 메모리 효율을 6배, 속도를 8배 높이는 알고리즘입니다.

- 시장 충격: 메모리 반도체 제조사들의 주가가 급락한 것은 ‘효율 향상 = 수요 감소’라는 단기적 우려 때문입니다.

- 장기 전망: 비용 감소는 곧 AI 서비스의 대중화를 이끌어 장기적으로는 더 많은 하드웨어 인프라(메모리 포함) 수요를 창출할 가능성이 높습니다.

- 관전 포인트: TurboQuant가 상용화되어 서버급 GPU에 광범위하게 적용될 시점의 실제 메모리 수요 변화를 주목해야 합니다.

References

- Google Research: TurboQuant Official Announcement

- NVIDIA Developer Blog: Optimizing LLM Inference on Hopper Architecture

- Investing.com: Semiconductor Market Daily Report (March 25, 2026)

- Business Korea: Samsung and SK Hynix React to Google’s New Algorithm

마치며

소프트웨어 기술의 발전은 때로 하드웨어 시장을 위협하는 것처럼 보이지만, 결국은 기술의 한계를 넓혀 시장 전체의 파이를 키워왔습니다. TurboQuant가 불러온 이번 소동 역시 AI 생태계가 성숙해가는 과정에서의 중요한 변곡점으로 기록될 것입니다.